ChatGPT使人工智能广泛应用,包括医生。其他类型的医疗人工智能和算法正变得越来越智能。随着FDA对许多算法进行评估,更高质量的算法将越来越多地进入常规临床应用,帮助检测心脏病发作和癌症的治疗决策。

从理论上讲,这些进步都是好消息。但是,除非医生改变他们的临床护理方式,否则它们不会带来更好的诊断能力和患者治疗。更糟糕的是,以错误的方式使用算法和人工智能可能会伤害患者,然而大多数美国医科学生目前对这些技术知之甚少。

我们最近在《新英格兰医学杂志》上提出了课程建议,让医生为即将到来的变化做好准备。为了从人工智能中受益,同时保证病人的安全,医生必须密切了解这些技术:它们如何“思考”,它们擅长什么,以及它们的局限性在哪里——就像你可能了解一个值得信赖的同事甚至配偶一样。

换句话说,医生应该把这些技术视为合作伙伴,而不是程序。

我们如何建立强有力的医生与人工智能伙伴关系?沟通是关键。但现在,医生和人工智能并不“说同一种语言”。

当医生思考和谈论疾病时,他们的语言是生理学的:涉及哪些身体系统,以及这些系统与患者症状或实验室结果的关系。但是,当算法和人工智能分析大量患者数据以预测结果或找到相关模式时,它们是以纯粹定量的方式进行的。他们的“语言”是一种数字概率:腹痛的女性有10%的概率是心脏病发作,CT扫描显示肺部肿块的患者有70%的概率是癌症。

拥有真实世界的概率可以帮助医生做出更好的诊断、预测和治疗建议。例如,医生可能会得出结论,患者具有某种特定诊断的“所有迹象”,但可能会从算法提醒中受益,即该诊断的概率低于50%,这意味着患者很容易患有其他疾病,医生应该继续调查(人工智能甚至可能会建议替代诊断)。

然而,这些好处只有在医生习惯使用和思考概率的情况下才能实现——而目前,许多医生都在努力做到这一点。

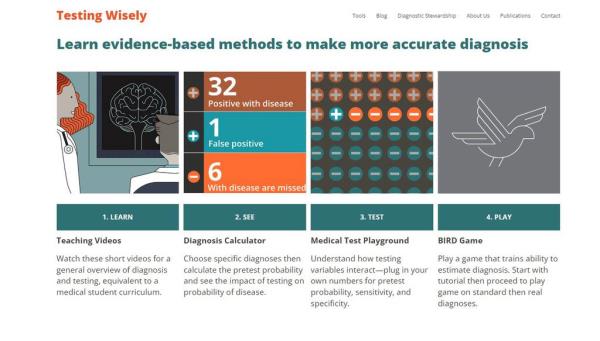

医生怎样才能更有可能地思考呢?首先,许多医学院学生在进入医学院之前从未学过统计学,我们同意其他人的观点,即统计学和流行病学比典型的医学预科微积分课程对医学实践更重要。一旦进入医学院,学生就应该练习运用概率来做决定,而不是简单地背公式。在马里兰大学医学院,我们开发了在线可视化工具(testingwisely.com),使人们从概率的角度进行思考更加直观,反映了决策和风险评估心理学的最新进展。

其次,医生必须了解他们的人工智能合作伙伴的局限性,并设定切合实际的期望。

例如,假设一个算法标记一个患者患心脏病的风险较低,因为他们每年的血液检查正常,而且他们没有糖尿病或高血压。如果病人的兄弟姐妹有过心脏病发作,但算法在做出预测时并不“知道”这些信息,这对医生来说很重要,可能意味着算法低估了病人的真实风险。更好、更透明的算法将减少(但不能完全防止)这些情况。因此,医生的判断——以及一些健康的怀疑——仍然至关重要。

最后,这是一个不成文的规则,夫妻关系通常会根据技能来分配任务(在我们各自的家庭中,我们通常负责洗碗)。医生与人工智能的合作也将是类似的。最终,算法可能会定期扫描患者的医疗记录,将他们的症状与可能被忽视的诊断联系起来,或者为癌症等疾病的发展提供量身定制的风险预测。由于当今医疗记录的庞大数量,在这方面,机器总是比医生做得更好。但是决定如何根据这些信息采取行动是只有医生和病人才能做的事情。它需要权衡潜在的危害、益处和患者的偏好。做好这一点需要批判性思维和与患者的清晰沟通,以支持共同决策。这些技能并不总是直觉性的,我们必须把它们教给医生。

今天,全国各地成千上万的学生都在医学院的头几个月。学生们现在学到的东西,以及医学如何适应算法和人工智能,将对患者护理产生重要影响。这些技术不仅仅是程序,但远不能取代医生。他们是合作伙伴,把他们的技能结合起来是一门艺术和科学。归根结底,我们都是病人——我们应该关心的是,医学应该正确处理这种关系。

凯瑟琳·古德曼(kgoodman@som.umaryland.edu)是一名流行病学家,马里兰大学医学院流行病学和公共卫生助理教授,马里兰大学健康计算研究所研究员。丹尼尔·摩根(dmorgan@som.umaryland.edu),内科医生,流行病学、公共卫生和传染病学教授,马里兰大学医学院诊断创新中心主任。